Le plug-in de navigateur Dark Pita détecte les motifs sombres, informe l'utilisateur et lui permet de personnaliser son expérience en ligne. Crédit : Toby Li / Université de Notre Dame

Des chercheurs de l’Université de Notre Dame développent des outils d’intelligence artificielle qui aident les consommateurs à comprendre comment ils sont exploités lorsqu’ils naviguent sur des plateformes en ligne. L’objectif est de renforcer les connaissances numériques des utilisateurs finaux afin qu’ils puissent mieux contrôler la manière dont ils interagissent avec ces sites Web.

Dans une étude récente parue dans Actes de la conférence CHI sur les facteurs humains dans les systèmes informatiques, les participants ont été invités à expérimenter les paramètres de confidentialité en ligne sans conséquence. Pour tester le fonctionnement des différents paramètres de confidentialité des données, les chercheurs ont créé un plug-in pour navigateur Chrome appelé Privacy Sandbox qui a remplacé les données des participants par des personnages générés par GPT-4, un grand modèle de langage d'OpenAI.

Avec Privacy Sandbox, les participants peuvent interagir avec différents sites Web, tels que des plateformes de médias sociaux ou des médias. Au fur et à mesure qu'ils naviguaient vers divers sites, le plug-in du navigateur appliquait des données générées par l'IA, ce qui permettait aux participants de voir plus clairement comment ils étaient ciblés en fonction de leur âge supposé, de leur race, de leur emplacement, de leurs revenus, de la taille de leur foyer, etc.

« Du point de vue de l'utilisateur, autoriser l'accès de la plateforme aux données privées peut être intéressant, car vous pourriez en tirer un meilleur contenu, mais une fois que vous l'avez activé, vous ne pouvez pas récupérer ces données. Une fois que vous l'avez fait, le site sait déjà où vous vous trouvez. en direct”, a déclaré Toby Li, professeur adjoint d'informatique et d'ingénierie et professeur affilié au Lucy Family Institute for Data & Society de Notre Dame, qui a dirigé la recherche. “C'est quelque chose que nous voulions que les participants comprennent, déterminent si le cadre en vaut la peine dans un environnement sans risque et leur permettent de prendre des décisions éclairées.”

Une autre étude, celle-ci en Actes de l'ACM sur l'interaction homme-machine, a examiné les modèles sombres (ou les caractéristiques de conception des plateformes numériques qui incitent subtilement les utilisateurs à effectuer des actions spécifiques) et la manière dont ils sont utilisés sur les sites Web pour manipuler les clients. Pour l’étude, Li et son équipe ont examiné comment les modèles sombres sont appliqués par les concepteurs d’interfaces pour encourager les gens à consommer davantage de contenu ou à prendre des décisions d’achat impulsives.

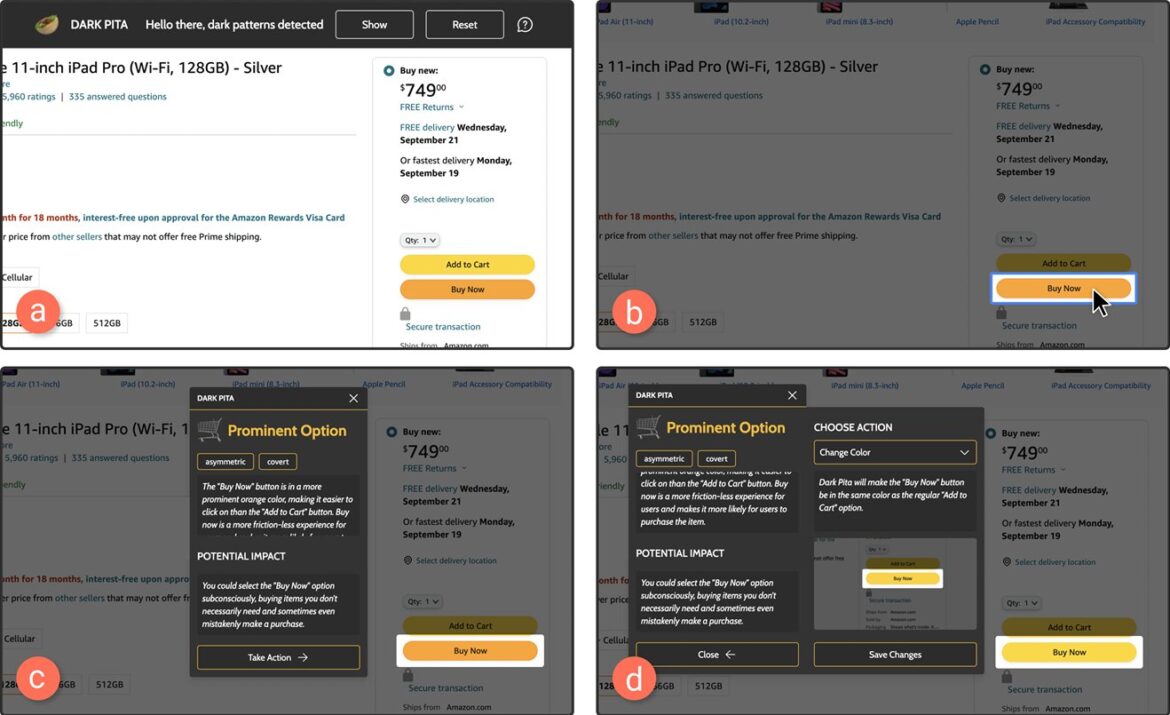

Les chercheurs ont développé un plug-in pour navigateur Chrome baptisé Dark Pita pour identifier les motifs sombres sur cinq plateformes en ligne populaires : Amazon, YouTube, Netflix, Facebook et X.

Grâce à l'apprentissage automatique, le plug-in informerait d'abord les participants à l'étude qu'un motif sombre a été détecté. Cela permettrait ensuite d’identifier la vulnérabilité du modèle sombre aux menaces et d’expliquer l’impact de ce modèle sombre : perte financière, atteinte à la vie privée ou fardeau cognitif. Dark Pita donnerait alors aux participants la possibilité de « passer à l'action » en modifiant le code du site Web via une interface facile à utiliser pour modifier les caractéristiques de conception trompeuses du site et expliquer l'effet de la modification.

Les chercheurs prévoient de rendre à terme les deux plug-ins de navigateur, Privacy Sandbox et Dark Pita, accessibles au public. Li pense que ces outils sont d'excellents exemples de la façon dont l'utilisation de l'IA peut être démocratisée pour les utilisateurs réguliers et bénéficier à la société.

“Les entreprises utiliseront de plus en plus l'IA à leur avantage, ce qui continuera à creuser l'écart de pouvoir entre elles et les utilisateurs. Ainsi, avec nos recherches, nous explorons comment nous pouvons redonner du pouvoir au public en lui permettant d'utiliser au mieux les outils d'IA. contre les algorithmes oppressifs existants. Cette approche « combattre le feu par le feu » devrait uniformiser un peu les règles du jeu », a déclaré Li.

« Une approche bac à sable basée sur l'empathie pour combler le fossé en matière de confidentialité entre les attitudes, les objectifs, les connaissances et les comportements » a été présentée lors de la conférence CHI 2024 de l'Association of Computing Machinery. Dirigée par Li, les co-auteurs de l'étude comprennent Chaoran Chen et Yanfang (Fanny) Ye de Notre Dame, Weijun Li de l'Université du Zhejiang, Wenxin Song de l'Université chinoise de Hong Kong et Yaxing Yao de Virginia Tech.

L'étude « From Awareness to Action: Exploring End-User Empowerment Interventions For Dark Patterns in UX », dirigée par Li, a été publiée dans le Actes de l'ACM sur l'interaction homme-machine (CSCW2024). Les co-auteurs incluent Yuwen Lu de Notre Dame, Chao Zhang de l'Université Cornell, Yuewen Yang de Cornell Tech et Yao de Virginia Tech.

Plus d'information:

Chaoran Chen et al, Une approche sandbox basée sur l'empathie pour combler le fossé en matière de confidentialité entre les attitudes, les objectifs, les connaissances et les comportements, Actes de la conférence CHI sur les facteurs humains dans les systèmes informatiques (2024). DOI : 10.1145/3613904.3642363

Yuwen Lu et al, De la sensibilisation à l'action : Exploration des interventions d'autonomisation des utilisateurs finaux pour les modèles sombres dans l'UX, Actes de l'ACM sur l'interaction homme-machine (2024). DOI : 10.1145/3637336

Fourni par l'Université de Notre Dame

Citation: Plugins de navigateur d'IA pour aider les consommateurs à améliorer leurs connaissances en matière de confidentialité numérique et à lutter contre la conception manipulatrice (29 mai 2024) récupéré le 29 mai 2024 sur

Ce document est soumis au droit d'auteur. En dehors de toute utilisation équitable à des fins d'étude ou de recherche privée, aucune partie ne peut être reproduite sans autorisation écrite. Le contenu est fourni seulement pour information.