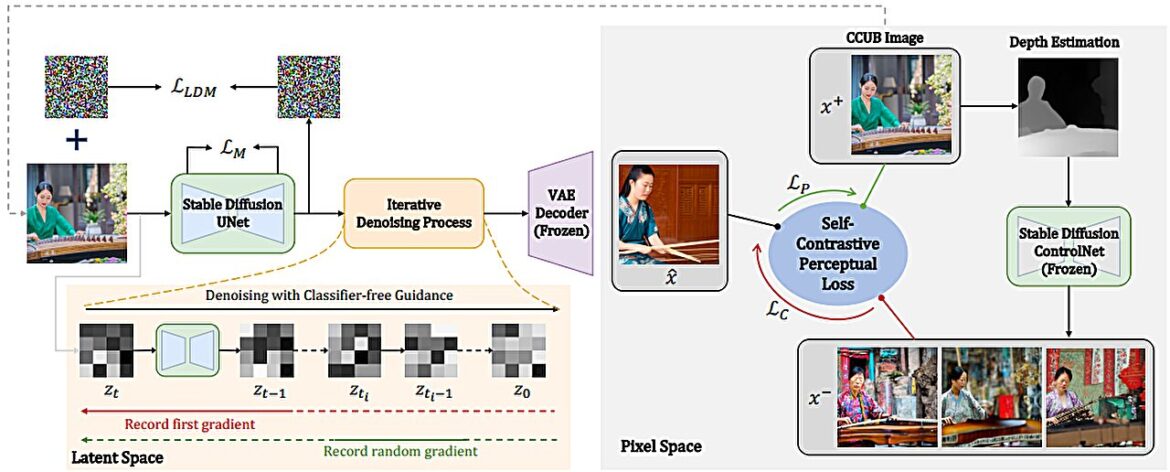

Présentation du SCoFT. Une perte de réglage fin conventionnelle, LMDLet perte de pénalité de mémorisation, LM, sont calculés dans l'espace latent de diffusion stable à l'aide d'images et de légendes de notre ensemble de données CCUB. Après 20 étapes de débruitage, l'espace latent est décodé. Les caractéristiques perceptuelles sont extraites de l'image générée et comparées de manière contrastée aux images CCUB sous forme d'images de diffusion stable positives et non affinées comme exemples négatifs pour former notre perte de perception auto-contrasive, L.C. Crédit: arXiv (2024). DOI : 10.48550/arxiv.2401.08053

Si vous demandez à un générateur d’images IA de vous donner une image de quelque chose, les résultats peuvent aller d’appropriés à ignorants en passant par carrément offensants. C’est particulièrement néfaste pour les cultures qui ne sont pas bien représentées dans les données Internet.

Une équipe internationale dirigée par l'Université Carnegie Mellon a utilisé le système Bridges-2 de PSC et les apports de plusieurs cultures différentes pour développer une approche de réglage efficace, le Self-Contrastive Fine-Tuning (SCoFT, prononcé « soft »), pour recycler une image populaire. générateur afin qu’il puisse générer des images équitables pour les cultures sous-représentées.

Si vous avez demandé à un moteur de recherche de vous donner l'image d'un objet ou d'une scène, vous avez peut-être remarqué quelque chose d'étrange. Vous obtenez parfois ce que vous demandez ; d’autres fois, les résultats sont déroutants. Et parfois, ils sont carrément méchants.

Le problème est amplifié lorsque quelqu'un demande à un générateur d'images IA de créer une image. Une image offensante sur le site Web d'une organisation dans un pays donné peut lui coûter des affaires ou des relations dans ce pays.

Certaines recherches suggèrent que les jeunes qui rencontrent des images négatives de personnes comme eux en ligne peuvent souffrir de taux plus élevés de dépression et d'automutilation. Et puis il y a simplement la honte de partager une image qui s’avère être, enfin, désemparée, encore moins offensante.

“Nous voulions utiliser la représentation visuelle comme moyen universel de communication entre les gens du monde entier”, a déclaré Jean Oh, professeur de recherche associé à l'Institut de robotique de la CMU. “Par exemple, les images générées peuvent faciliter l'apprentissage des langues étrangères des personnes âgées dans le cadre de notre projet de collaboration internationale au sein du programme NSF AI-CARING.

“Mais lorsque nous avons commencé à générer des images sur la Corée, la Chine et le Nigeria, nous avons immédiatement observé que les modèles de fondations populaires n'avaient aucune idée du monde en dehors des États-Unis. Si nous redessinons la carte du monde sur la base de ce que savent ces modèles, elle sera assez biaisée. “.

Ce n'est pas surprenant. Ces modèles ont été formés sur les données d'Internet. Et Internet, bien que mondial, a tendance à être dominé par le contenu occidental, notamment américain et anglais.

Une équipe de recherche dirigée par Oh travaille sur la manière de rendre les modèles d’IA génératifs conscients de la diversité des personnes et des cultures. Pour atteindre cet objectif, son équipe a développé une nouvelle approche de réglage fin et, grâce à une allocation du projet ACCESS de la NSF, a utilisé le supercalculateur Bridges-2 de PSC pour former de nouveaux modèles et exécuter des séries d'expériences afin de vérifier les performances de l'approche proposée.

Comment la CFP a aidé

À un moment donné, les scientifiques développant les approches d’IA sous-jacentes à la génération d’images pensaient que plus nous disposions de données, meilleurs seraient les résultats. Cependant, Internet ne s’est pas vraiment déroulé ainsi. En plus d’être dominé par les images et les données occidentales, il existe de très mauvaises choses. Pour de nombreuses raisons, les données massives ne nous orientent pas toujours dans la bonne direction.

Les IA de Deep Learning apprennent par force brute, en commençant par faire des suppositions aléatoires sur un ensemble de données d'entraînement dans lequel les humains ont étiqueté les « bonnes » réponses. Au fur et à mesure que l'ordinateur fait de bonnes ou de mauvaises suppositions, il utilise ces étiquettes pour se corriger, devenant finalement suffisamment précis pour tester des données pour lesquelles il n'a pas reçu de réponses.

Pour la tâche de génération d'images basées sur des requêtes effectuées avec du texte, un outil d'IA appelé Stable Diffusion est un exemple de l'état de l'art, ayant été formé sur l'ensemble de données LAION de 5,85 milliards de paires texte-image.

Mais demandez à Stable Diffusion de vous donner une image d'une rue moderne à Ibadan, au Nigeria, et cela crée quelque chose qui ressemble davantage au stéréotype négatif d'un Occidental d'une rue de ville africaine : un chemin de terre délabré avec des détritus dans la rue et des vêtements suspendus. depuis les fenêtres. D’autres images qui apparaissent, pour d’autres cultures, peuvent être moins manifestement offensantes. D'une certaine manière, c'est pire, car c'est plus difficile à identifier.

Pour améliorer cela, l’équipe du Robotics Institute a recruté des personnes issues de cinq cultures pour constituer un petit ensemble de données culturellement pertinentes. Bien que cet ensemble de données CCUB (Cross-Cultural Understanding Benchmark) ne contienne en moyenne qu'environ 140 paires texte-image pour chaque culture, il a permis à l'équipe de recycler Stable Diffusion pour lui apprendre à générer des images décrivant chaque culture avec plus de précision et avec moins de stéréotypes. par rapport au modèle de base. L’équipe a également ajouté la même étape de réglage fin aux images générées par le populaire générateur d’images GPT-3 AI.

“J'utilise un mode GPU partagé à des fins de formation”, a déclaré Zhixuan Liu, étudiant diplômé du groupe d'Oh et premier auteur du nouvel article décrivant le travail. “Mes recherches nécessitent de mener plusieurs études d'ablation dans divers domaines culturels, ce qui rend impossible la réalisation de ces expériences sans s'engager dans des tâches parallèles sur la plateforme (Bridges-2).

“En outre, le projet implique le réglage fin d'un modèle texte-image à grande échelle, exigeant des ressources de formation substantielles que PSC propose volontiers.”

Bridges-2 s'est avéré idéal pour les travaux. Le système phare de PSC offre de puissantes unités de traitement graphique (GPU) compatibles avec la reconnaissance d'images et de formes, ainsi qu'une architecture conçue pour permettre aux données volumineuses de circuler efficacement dans l'ordinateur sans blocages. Cela a permis aux scientifiques d’affiner l’IA par étapes progressives, ce qui a considérablement amélioré les impressions que 51 personnes de cinq cultures réceptrices ont eues à partir des images résultantes.

Leur méthode SCoFT a amélioré la perception des juges quant à la façon dont l'image correspondait à la requête textuelle, à quel point elle représentait leur culture, et a également réduit le caractère offensant des images.

L'équipe présentera un article sur ses travaux lors de la conférence 2024 IEEE/CVF sur la vision par ordinateur et la reconnaissance de formes (CVPR 24), qui débute le 19 juin 2024. Il est actuellement disponible sur le site Web de l'IEEE/CVF. arXiv serveur de préimpression.

Les objectifs futurs incluent l’adaptation du SCoFT à bien plus que les seules cultures nationales. Dans une application étendue, par exemple, SCoFT a amélioré les images de personnes portant des prothèses vues par cette communauté.

Plus d'information:

Zhixuan Liu et al, SCoFT : réglage fin auto-contraste pour une génération d'images équitable, arXiv (2024). DOI : 10.48550/arxiv.2401.08053

arXiv

Fourni par le Pittsburgh Supercomputing Center

Citation: Un superordinateur aide à recycler les IA pour éviter de créer des images offensantes pour des cultures spécifiques (4 juin 2024) récupéré le 4 juin 2024 sur

Ce document est soumis au droit d'auteur. En dehors de toute utilisation équitable à des fins d'étude ou de recherche privée, aucune partie ne peut être reproduite sans autorisation écrite. Le contenu est fourni seulement pour information.